-

Get a Personalized Demo

- Soluciones

-

Servicios Empresariales

Estrategia de Nube Seguridad Cibernética Servicios Administrados Gestión de Socios Servicios de Portación

- Industrias

-

Industries We Serve

- Conocimientos

-

Recursos

Eventos

Ready to learn more about IAG now?

Watch our on-demand video on how identity management is

done in a typical organization.

- Carreras

-

We’re constantly on the hunt for talented individuals who are passionate about innovative technologies

- Socios

-

Socios

Partner Program

- Compañia

-

GLOBAL

Sobre ISSQUARED -

IN INDIA

ISSQUARED

- Book a Demo

-

Book a Demo

Fabulix Service Manage (FSM)

-

- Español

- العربية

- Français

- English

- Dutch

Thank you for your interest. We Will Contact You Soon...Your email ID is already registered with us.Inteligencia artificial explicable (XAI): una introducción

Tecnología - 29 de enero de 2021

Alan Turing, considerado el padre de la informática moderna, dijo una vez: "Una computadora merecería ser llamada inteligente si pudiera engañar a otro ser humano haciéndole creer que es humano". Se refirió a la capacidad de la máquina para imitar a un humano, para tener un diálogo inteligible y preciso.

Setenta años después, ahora contamos con una inteligencia artificial (IA) avanzada. La IA es el intento continuo de la humanidad de hacer que la máquina sea más inteligente e intuitiva. Hoy en día, la IA está trabajando entre bastidores para ayudarnos en nuestras actividades diarias. Está impulsando vehículos autónomos y de estacionamiento, asistentes digitales en nuestros teléfonos inteligentes y otras aplicaciones que usamos todos los días, como correos electrónicos y redes sociales. AI también está ayudando a investigadores y autoridades en la lucha contra COVID-19. Un ejemplo de esto se puede ver a fines de diciembre de 2019 cuando BlueDot, una plataforma de inteligencia artificial, informó un aumento en los casos de "neumonía inusual" en la región de Wuhan en China. Esto alertó a las autoridades para investigar el asunto y tomar acciones correctivas. Hoy en día, la IA está ayudando a los investigadores en las pruebas de COVID-19 y el desarrollo de vacunas.

Las aplicaciones de inteligencia artificial empoderan a los sistemas autónomos que perciben, aprenden y luego deciden por sí mismos. Estos sistemas utilizan tecnologías como el aprendizaje automático y el procesamiento del lenguaje natural (PNL) para trabajar con grandes conjuntos de datos y luego darnos un resultado. Sin embargo, existe el problema de que los sistemas no nos dicen el razonamiento detrás de las decisiones que toman. Nos dan la salida, pero no nos dicen por qué nos han dado esa salida.

Piense en un médico que utiliza un sistema de inteligencia artificial. El sistema le da la recomendación para realizar una tarea en particular, pero el médico no se sentirá cómodo usando la recomendación sin conocer su razonamiento.

Es un gran vacío que debe llenarse. Los sistemas de inteligencia artificial nunca podrán ganarse la confianza de las personas si no revelan su razonamiento. Incluso los diseñadores de IA no pueden explicar por qué su sistema tomó una decisión específica. Esto presenta un escenario de "caja negra" donde nadie sabe qué hay debajo de esa caja o cómo funciona. Esta "caja negra" tiene el potencial de limitar el alcance y el alcance de la propia IA. Parafraseando a Alan Turing, si no pueden tener una conversación transparente con los humanos. Hoy en día, hay eficiencia pero poca comunicación, y esto puede ser un factor decisivo para muchos.

Ingrese la IA explicable

¿Qué es la IA explicable?

En términos simples, la IA explicable (XAI) es una aplicación de inteligencia artificial que proporciona un razonamiento comprensible de cómo llegó a una conclusión determinada.

La IA explicable añade transparencia a la "caja negra" y permite que los profesionales humanos la examinen y la comprendan. Es un gran paso adelante para hacer que la IA sea más ética.

Veámoslo en detalle.

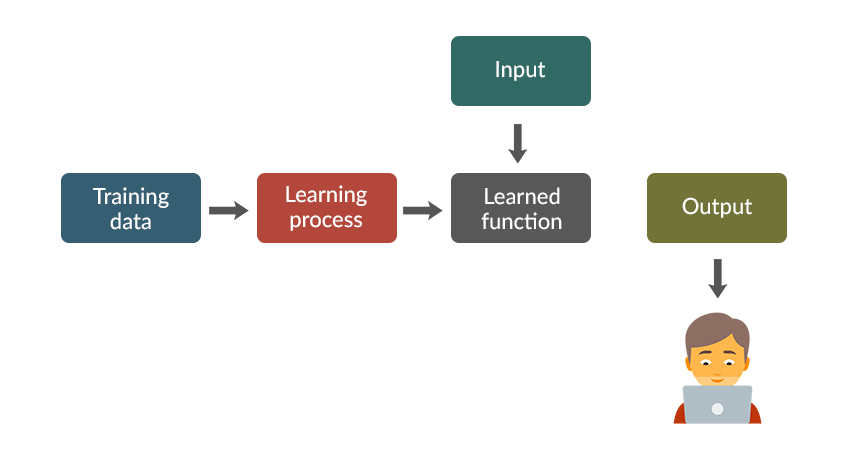

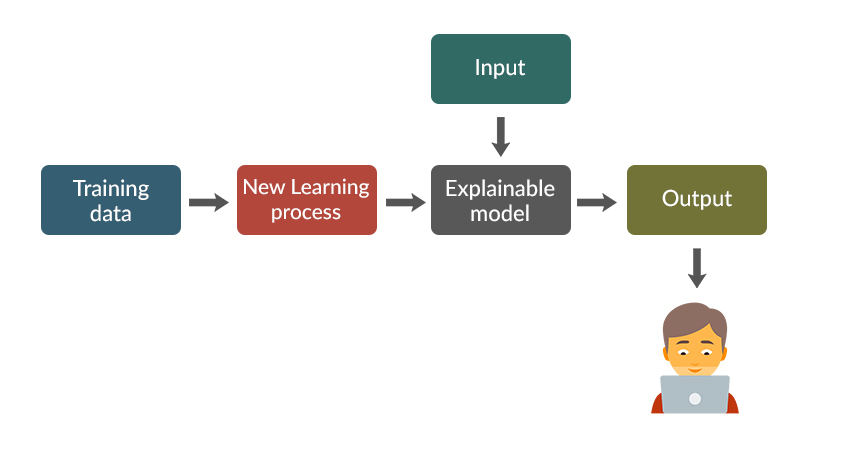

Un flujo de trabajo de aprendizaje automático habitual se parece a esto:

Primero, usamos datos para entrenar el modelo con un proceso de aprendizaje específico.

El proceso de aprendizaje conduce luego a una función aprendida.

Las entradas se introducen en la función aprendida.

La máquina predice la salida. El usuario ve esta salida.

Una vez que se aprende la función, se pueden introducir nuevas entradas en el modelo y la máquina devolverá la predicción deseada.

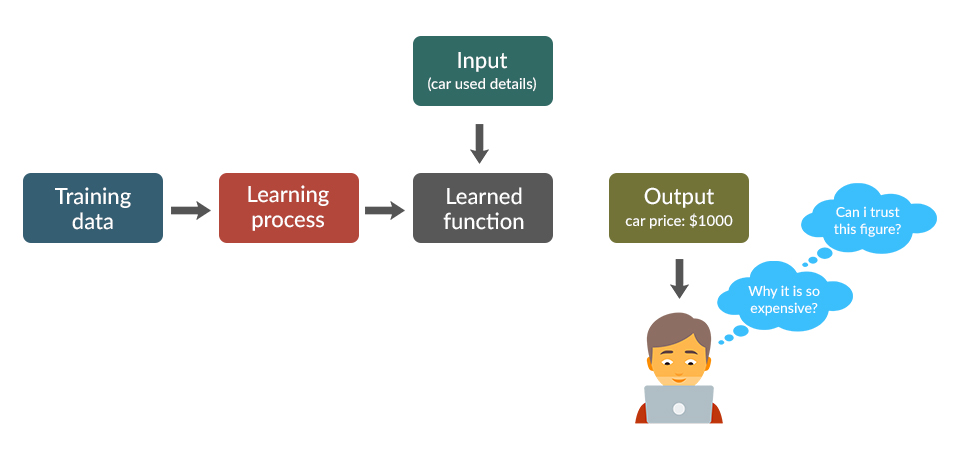

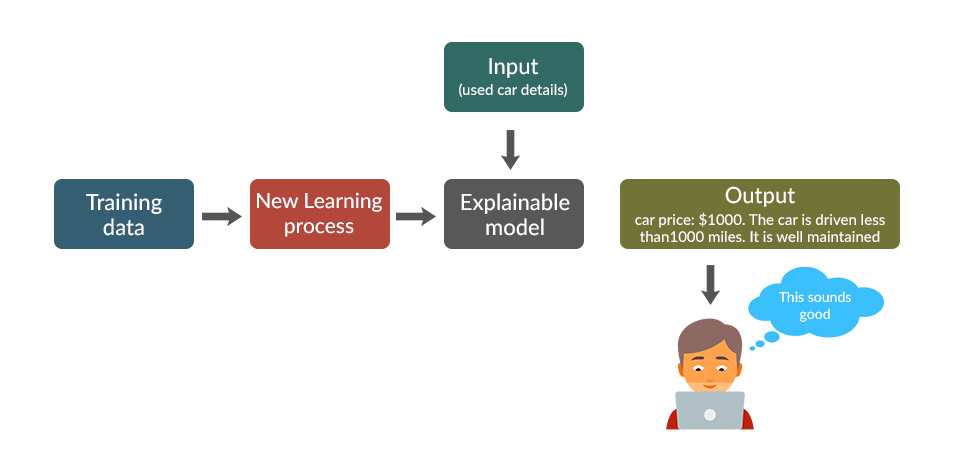

Veamos un ejemplo. Sam quiere comprar un auto usado y está interesado en conocer su precio. Tomamos el modelo y lo entrenamos con un proceso de aprendizaje. A continuación, alimentamos las entradas (que son detalles del automóvil usado) y el algoritmo de aprendizaje automático devuelve una predicción del precio del automóvil de entrada. Sam puede mirar el precio y decidir si sería una buena compra.

Lo fundamental a tener en cuenta aquí es que hay predicción pero no justificación. Puede confundir a Sam, ya que debe confiar ciegamente en la máquina para tomar la decisión correcta.

Por otro lado, la IA explicable sigue el siguiente marco:

Como puede ver, aquí hay un nuevo proceso de aprendizaje. Este proceso de aprendizaje no solo nos da la predicción, sino que también explica por qué hizo tal predicción. En la nueva salida, el usuario obtiene información adicional sobre por qué se hizo la predicción. El modelo del ejemplo anterior se verá así:

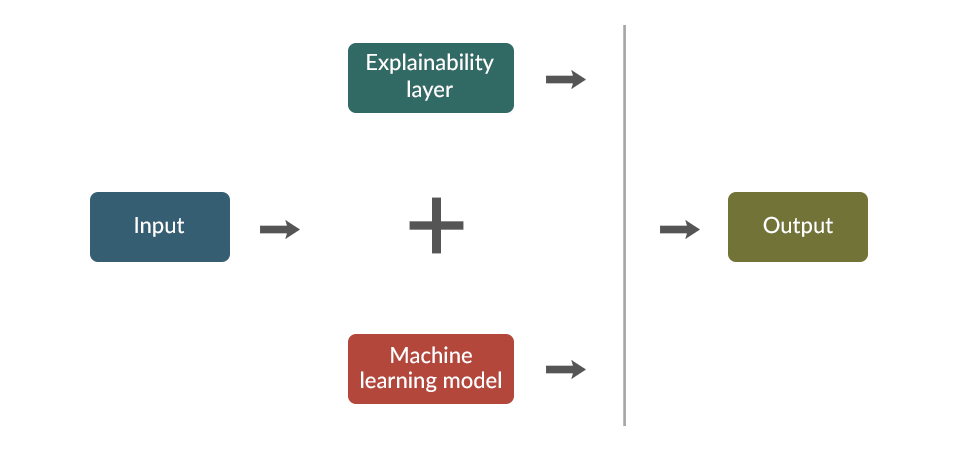

Se agrega una capa de capacidad para explicar en el diseño de ML para crear un modelo de IA explicable.

La capa adicional es crucial porque:

La explicabilidad ayuda a garantizar la imparcialidad en la toma de decisiones. Ayuda a detectar y corregir cualquier sesgo en los conjuntos de datos.

La explicabilidad destaca los factores potenciales que podrían cambiar la predicción.

XAI: Empresas liderando el camino

En el pasaje a continuación, veremos algunas empresas que son pioneras en la tecnología XAI y la llevan al mundo.

IBM: IBM completó una completa encuesta interna y descubrió que más del 60% de sus ejecutivos no se sentían cómodos con el enfoque tradicional de la "caja negra" de la IA. IBM ha desarrollado una herramienta avanzada de inteligencia artificial basada en la nube y utiliza la tecnología XAI para proporcionar el razonamiento detrás de las recomendaciones de inteligencia artificial.

Google: Google ha creado una plataforma de inteligencia artificial habilitada para XAI que proporciona explicaciones sobre varias de las funciones de Google, como el reconocimiento de imágenes y el muestreo de código.

Darwin AI: Fundada en 2017, DarwinAI participa en un proceso conocido como "síntesis generativa". En este método, DarwinAI usa IA para comprender el funcionamiento de una red neuronal de aprendizaje profundo. Ofrece un kit de herramientas de explicabilidad, una función fácil de usar que realiza diagnósticos de red, depuración de red, etc.

Flowcast: Flowcast: The company uses its proprietary AI technology to build explainable credit assessment models. This has the potential to completely transform the credit regulations and help financial institutions adhere to regulatory compliance.

Imandra: Imandra está trabajando para hacer que los algoritmos sean justos, explicables y seguros. Ofrece su solución de "razonamiento como servicio" que lleva la tecnología XAI a dominios clave. Comenzó en el sector financiero pero se expandió lentamente a otras industrias como transporte, robótica, etc.

Kyndi: Kyndi ofrece una plataforma dedicada de NLP (procesamiento de lenguaje natural) y tiene como objetivo crear sistemas de IA auditables.

Factmata: Factmata fue una de las primeras empresas que abordó los problemas de las noticias falsas en línea. Utiliza técnicas de inteligencia artificial para filtrar noticias creíbles de las falsas y utiliza técnicas XAI para justificar la segregación.

Pensamientos finales

La innovación debe ir de la mano de la confianza; ningún negocio o tecnología puede tener éxito sin confianza. Según un informe de PWC, la inteligencia artificial será responsable de las ganancias del PIB de hasta $15 billones para 2030. La empresa también realizó una encuesta en 2017, donde más del 70 por ciento de los ejecutivos creían que la inteligencia artificial afectaría todos los aspectos del negocio de una organización. A medida que la IA se vuelve cada vez más común, es importante que se vuelva ética y responsable, y XAI es un gran paso adelante en ese aspecto.

Historias relacionadas

Amenaza vs Vulnerabilidad vs Riesgo

9 de diciembre de 2020¿Por qué IAM es una herramienta indispensable?

4 de diciembre de 2020Qué es 5G: todo lo que necesita saber

1 de diciembre de 2020Trabajo desde casa y la importancia de la de estrategias de ciberseguridad

04 de mayo de 2020Vulnerabilidades de Seguridad Cibernética Comúnmente Pasadas por...

04 de mayo de 2020¿Qué impacto tiene el análisis predictivo en su negocio?

08 de abril de 2020Zoom, Skype, Teams: la batalla por la dominación del mercado en los tiempos...

10 de abril de 2020Inteligencia artificial en la lucha contra el Coronavirus

24 de marzo de 2020Es hora de la transición: cómo Microsoft Teams es mejor que Skype for Business

05 de marzo de 2020Desmitificando los mitos que rodean a Cloud

26 de marzo de 2020Microsoft Teams vs Slack - ¿Cuál es Realmente la Mejor Herramienta?

09 de Octubre de 2019Microsoft Azure RI

24 de marzo de 2020CENTRO DE SUSCRIPCIÓN

Manténgase al tanto de nuestro boletín informativo

This website uses cookies or similar technologies, to enhance your browsing experience and provide personalized recommendations. By continuing to use our website, you agree to our Privacy Policy

Thank you for your interest. We Will Contact You Soon...Your email ID is already registered with us. - Soluciones